Definition, Risiken und Rechtslage in Deutschland

Was sind Deepfakes?

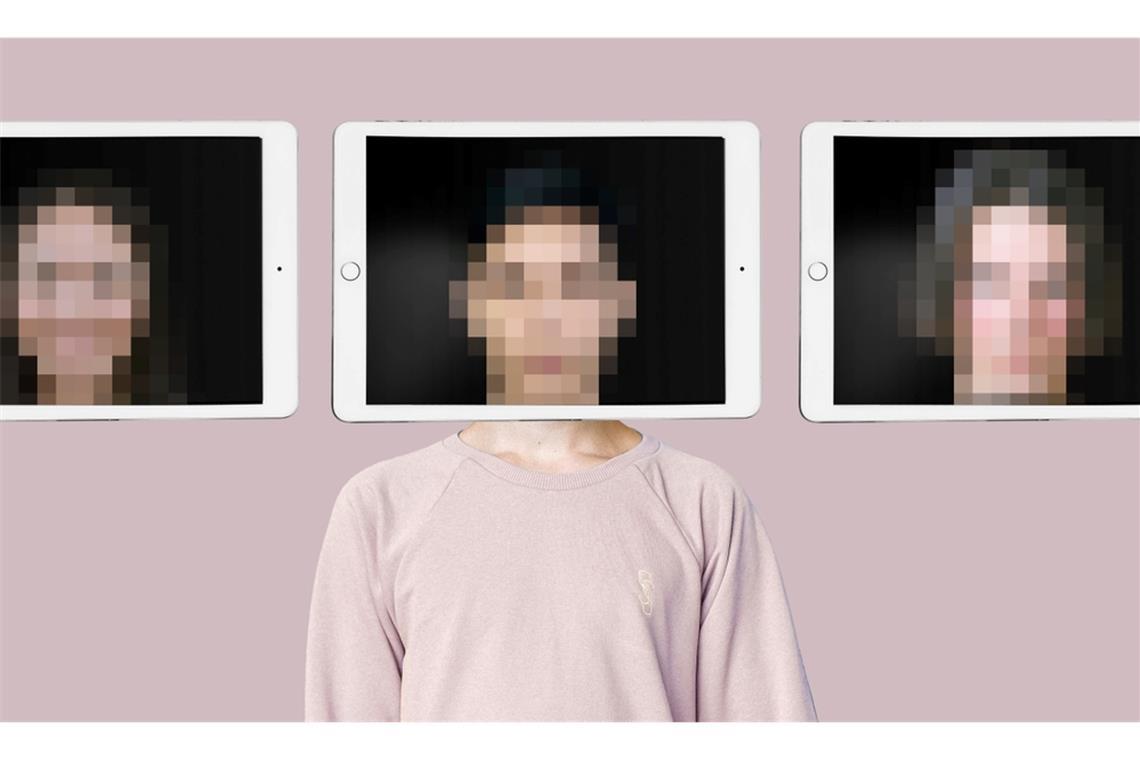

Täuschend echte Videos, gefälschte Nacktbilder, missbrauchte Identitäten: Deepfakes sind längst kein Zukunftsthema mehr, sondern Teil der digitalen Realität. Doch was genau steckt dahinter, was ist in Deutschland bereits strafbar und wie kann man sich schützen?

Was sind Deepfakes?

Von Katrin Jokic

Die Vorwürfe der Schauspielerin Collien Fernandes gegen ihren Ex-Mann Christian Ulmen haben zuletzt eine breite Debatte über sogenannte Deepfakes ausgelöst. Unabhängig vom konkreten Fall zeigt die Diskussion, wie relevant das Thema „digitale Gewalt“ geworden ist und wie unsicher viele Menschen bei der Einordnung sind.

Was genau sind Deepfakes?

Der Begriff „Deepfake“ setzt sich aus „Deep Learning“ (eine Form künstlicher Intelligenz) und „Fake“ zusammen. Gemeint sind täuschend echt wirkende Fotos, Videos oder Audioaufnahmen, die mit Hilfe von KI künstlich erzeugt oder manipuliert werden.

Typische Beispiele:

Je mehr Bild- und Tonmaterial von einer Person existiert, desto realistischer wirken solche Fälschungen. Die technische Hürde ist inzwischen niedrig: Viele Anwendungen sind frei verfügbar und lassen sich ohne Vorkenntnisse bedienen.

Wofür werden Deepfakes genutzt?

Deepfakes haben nicht nur negative Einsatzmöglichkeiten. Sie werden etwa auch in Filmproduktionen oder Satire eingesetzt. Problematisch wird es vor allem in drei Bereichen:

In diesen Fällen spricht man häufig von „digitaler Gewalt“ – einem Sammelbegriff für Angriffe auf Persönlichkeit, Privatsphäre und Sicherheit im Netz.

Wie ist die Rechtslage in Deutschland?

Ein zentrales Problem: Einen eigenen Straftatbestand für Deepfakes gibt es bislang nicht. Trotzdem sind viele Handlungen rund um Deepfakes bereits heute strafbar, je nach Einzelfall.

Diese Gesetze können greifen

Wichtig:

Gibt es rechtliche Lücken?

Ja, vor allem beim reinen Erstellen von Deepfakes ohne Veröffentlichung. Hier greift das Strafrecht häufig noch nicht eindeutig.

Deshalb arbeitet die Politik an einem „Digitalen Gewaltschutzgesetz“. Diskutiert wird unter anderem die Strafbarkeit bereits für die Herstellung bestimmter Deepfakes, bessere Identifizierung von Tätern (z. B. IP-Speicherung) sowie schnellere Sperrung von Accounts. Auch auf EU-Ebene sollen Deepfakes künftig klarer geregelt werden.

Wie kann man sich schützen?

Ein vollständiger Schutz vor Deepfakes ist kaum möglich. Dennoch gibt es einige Maßnahmen, mit denen sich das Risiko deutlich verringern lässt.

Je weniger Bild- und Videomaterial frei im Internet verfügbar ist, desto schwieriger wird es, realistische Deepfakes zu erstellen. Es kann sinnvoll sein, Social-Media-Profile auf privat zu stellen und ältere Inhalte regelmäßig zu überprüfen. Fotos oder Videos, die nicht mehr notwendig sind, sollten im Zweifel gelöscht werden.

Nicht jedes Bild gehört ins Netz. Vor allem sensible oder sehr persönliche Aufnahmen sollten nicht öffentlich zugänglich gemacht werden. Das gilt insbesondere für Inhalte, die leicht missbraucht werden könnten. Auch bei beruflichen Profilen empfiehlt sich Zurückhaltung: Je mehr hochwertiges Material verfügbar ist, desto einfacher lässt es sich technisch weiterverarbeiten.

Es lohnt sich, regelmäßig zu prüfen, welche Inhalte im eigenen Namen im Internet auftauchen. Eine einfache Suche bei Google kann bereits Hinweise liefern. Ergänzend können sogenannte Reverse-Image-Suchen helfen, um herauszufinden, ob eigene Fotos an anderer Stelle im Netz verwendet werden.

Wenn gefälschte Inhalte auftauchen, ist schnelles Handeln entscheidend. Je früher problematische Inhalte gemeldet werden, desto größer ist die Chance, dass sie rasch entfernt werden.

Was Betroffene konkret tun können

Wer Opfer von Deepfakes wird, ist der Situation nicht schutzlos ausgeliefert. Es gibt mehrere Schritte, die helfen können, gegen die Inhalte vorzugehen und die eigenen Rechte durchzusetzen.

Der erste Schritt sollte sein, die betroffenen Inhalte direkt bei der Plattform zu melden, auf der sie veröffentlicht wurden, etwa bei Instagram, TikTok oder anderen sozialen Netzwerken. Große Plattformen sind gesetzlich verpflichtet, entsprechende Meldemöglichkeiten bereitzustellen. Zusätzlich können Beschwerden über die sogenannten NetzDG-Meldewege eingereicht werden. Auch bei Google lassen sich Suchergebnisse beanstanden, sodass problematische Inhalte zumindest schwerer auffindbar werden.

Parallel dazu ist es wichtig, Beweise zu sammeln. Dazu gehören Screenshots der Inhalte, vollständige Internetadressen (URLs) sowie gegebenenfalls Chatverläufe oder Nachrichten. Diese Dokumentation ist entscheidend, um später rechtlich gegen die Verantwortlichen vorgehen zu können.

In vielen Fällen kommt auch eine Strafanzeige infrage. Diese kann bei der Polizei gestellt werden, oft auch online. Wichtig ist: Bei bestimmten Delikten muss zusätzlich ein sogenannter Strafantrag gestellt werden, und dafür gelten Fristen. Wer zu lange wartet, riskiert, dass eine Strafverfolgung nicht mehr möglich ist.

Neben dem Strafrecht gibt es auch zivilrechtliche Möglichkeiten. Betroffene können verlangen, dass die Inhalte künftig nicht mehr verbreitet werden (Unterlassungsanspruch). In schweren Fällen kommen auch Schadensersatz oder eine Geldentschädigung in Betracht, etwa bei erheblichen Persönlichkeitsrechtsverletzungen.

Niemand muss allein mit der Situation umgehen. Beratungsstellen wie HateAid oder der Weiße Ring bieten Unterstützung und Orientierung. Zusätzlich kann es sinnvoll sein, frühzeitig einen spezialisierten Anwalt für Medien- oder Strafrecht einzuschalten, um die eigenen Ansprüche gezielt durchzusetzen.

Problem erkannt – Lösung noch im Aufbau

Deepfakes sind längst kein Nischenthema mehr. Die Technik ist einfach zugänglich, die möglichen Schäden sind erheblich.

Die Rechtslage in Deutschland ist dabei komplex: Viele Handlungen sind bereits strafbar, aber nicht immer eindeutig und nicht immer ausreichend schnell durchsetzbar. Genau hier setzt die aktuelle gesellschaftliche und politische Debatte an.

Klar ist: Die Lücke im Schutz vor digitaler Gewalt existiert. Und mit der rasanten Entwicklung von KI dürfte der Druck auf Gesetzgeber und Plattformen weiter steigen.